È l’ennesima nuova tecnologia di intelligenza artificiale: realizzata dall’azienda cinese già proprietaria del famosissimo social TikTok, è diventata nota in poco tempo per la straordinaria (e inquietante) capacità di creare video falsi, indistinguibili dal vero, partendo quasi da zero.

Una capacità generativa impressionante, che però solleva inevitabili domande sui potenziali rischi di confusione tra realtà e menzogna, in un mondo (digitale e non) già ostaggio delle fake news

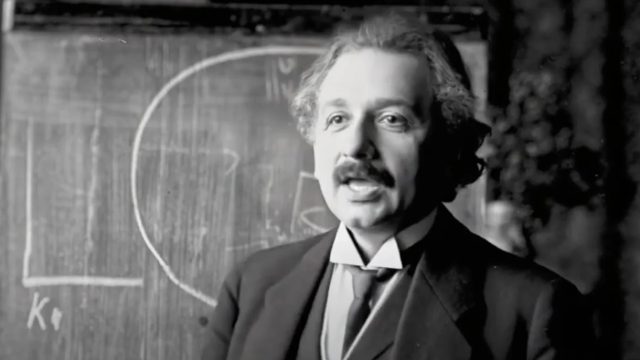

L’incredibile rapidità con cui evolve l’intelligenza artificiale non è un mistero, e con essa migliorano anche tutte le sue applicazioni. Una di queste è la creazione di deepfake: contenuti in cui volti o voci di altre persone vengono sovrapposti a immagini o video già esistenti, manipolandoli in maniera estremamente realistica. Se fino a pochi anni fa i deepfake, per quanto impressionanti, tradivano la loro natura con movimenti innaturali o una scarsa sincronizzazione tra voce e movimenti delle labbra, le nuove tecnologie rendono sempre più difficile distinguerli dalla realtà. Una di queste è Omnihuman, l’intelligenza artificiale dell’azienda cinese Byte-Dance, proprietaria di TikTok.

Il modello su cui si basa Omnihuman è in grado di generare un video deepfake a partire da una singola immagine e una traccia audio o di modificare riprese già esistenti alterando i volti delle persone presenti, ottenendo risultati straordinariamente naturali. I limiti dei deepfake tradizionali sembrano un ricordo: grazie all’elevata quantità di dati di addestramento del modello, i movimenti delle labbra e del corpo risultano notevolmente migliorati a fronte di una quantità inferiore di input. Omnihuman, però, non è perfetto: gli sviluppatori stanno lavorando sulle complessità legate a immagini di bassa qualità o a pose articolate, unici dettagli che possono rivelare ad un occhio attento la natura artificiale del contenuto.

Forse proprio per la presenza di questi piccoli difetti Omnihuman non è ancora stato reso disponibile pubblicamente, ma non si esclude un debutto nei prossimi mesi come una nuova funzionalità della piattaforma TikTok. Nell’attesa, è possibile accedere ad altri strumenti che, seppur non all’altezza di Omnihuman, sono in grado creare deepfake piuttosto realistici: un esempio, disponibile in tutto il mondo ad eccezione dell’Unione Europea, è Sora di OpenAI, il generatore di video integrato nel chatbot ChatGPT.

Al momento disponibile solo per gli utenti abbonati ai piani Plus e Pro, Sora può generare filmati sulla base di istruzioni testuali, modificare o rimuovere elementi da un video originale, unire più riprese o cambiarne lo stile, sfruttando un algoritmo avanzato di intelligenza artificiale.

Sempre più sottile il confine tra vero e falso. I rischi

Le potenzialità di queste nuove tecnologie sono senza dubbio affascinanti, ma cosa nasconde l’altra faccia della medaglia? Inevitabilmente, la precisione nella manipolazione di filmati che caratterizza Omnihuman e affini strada ad una serie di sfide, cominciare dalla disinformazione già dilagante sui social media. Se già siamo abituati a osservare con sguardo critico i contenuti pubblicati su queste piattaforme, distinguere una notizia attendibile da una bufala diventerà ancora più complesso. I rischi legati all’uso improprio dei deepfake diventano ancora più preoccupanti quando la diffusione di false informazioni tocca temi sensibili, come la politica. Negli ultimi anni non sono mancati esempi di fake news create attraverso questi strumenti, a partire dal video del presidente ucraino Zelensky che, ad un mese dallo scoppio della guerra, sembrava ordinare al proprio esercito di arrendersi, fino alla manipolazione delle dichiarazioni dei candidati alle recenti elezioni presidenziali americane. Un ulteriore campanello d’allarme riguarda sicurezza informatica: tra i diversi utilizzi del deepfake non sono mancati tentativi di frode o revenge porn, di cui ad oggi sono stati vittima soprattutto i personaggi pubblici, tra i quali la premier italiana Meloni.

Se da un lato le stesse piattaforme social sono intervenute per combattere la disinformazione generata dai contenuti realizzati con IA, segnalandoli con apposite etichette, per tutelare i soggetti esposti alla manipolazione di proprie immagini o video per scopi impropri o illegali c’è ancora molta strada da fare. Una minaccia che può diventare quanto mai concreta se tecnologie avanzate come Omnihuman,

una volta rese disponibili al grande pubblico, finissero nelle mani sbagliate. I primi a pagarne le spese potrebbero essere proprio i giovanissimi, a cui ancora mancano gli strumenti per usare l’IA in modo consapevole, rischiando di ferire se stessi o i propri coetanei.

In previsione di un prossimo lancio di Omnihuman, per fare in modo che rimanga un’utile risorsa e non si trasformi in un’arma di inganni o cyberbullismo, è fondamentale non smettere di informarci e di informare chi ci circonda su come impiegare queste tecnologie in maniera consapevole, con un occhio di riguardo per i più giovani: solo così, tenendo accanto il nostro personale “manuale di istruzioni” per l’IA, saremo in grado di osservare con più serenità il suo incredibile progresso.

Giulia Cucchetti